Gli agenti AI stanno trasformando il modo in cui si lavora e come deve essere garantita la sicurezza.

L'IA con capacità di agire sta creando un nuovo livello di rischio

L'adozione dell'IA con capacità di agire sta accelerando

Nel sondaggio Gartner 2025 Cybersecurity Innovations in AI Risk Management and Use, il 53% degli intervistati ha dichiarato di aver già implementato l'automazione tramite agenti IA personalizzati. Fonte: Gartner, How to Secure Custom-Built AI Agents, giugno 2025.

L'IA con capacità di agire prenderà decisioni aziendali importanti

Almeno il 15% delle decisioni lavorative quotidiane sarà preso in modo autonomo grazie all'intelligenza artificiale con capacità di agire, rispetto allo 0% del 2024. Fonte: Gartner, TSP 2025 Trends: Agentic AI – The Evolution of Experience, febbraio 2025.

I dipendenti potrebbero non seguire le politiche sull'AI

Un terzo delle interazioni con i servizi di IA generativa (GenAI) attiverà modelli di azione e agenti autonomi per completare i compiti. Fonte: Gartner, TSP 2025 Trends: Agentic AI – The Evolution of Experience, febbraio 2025.

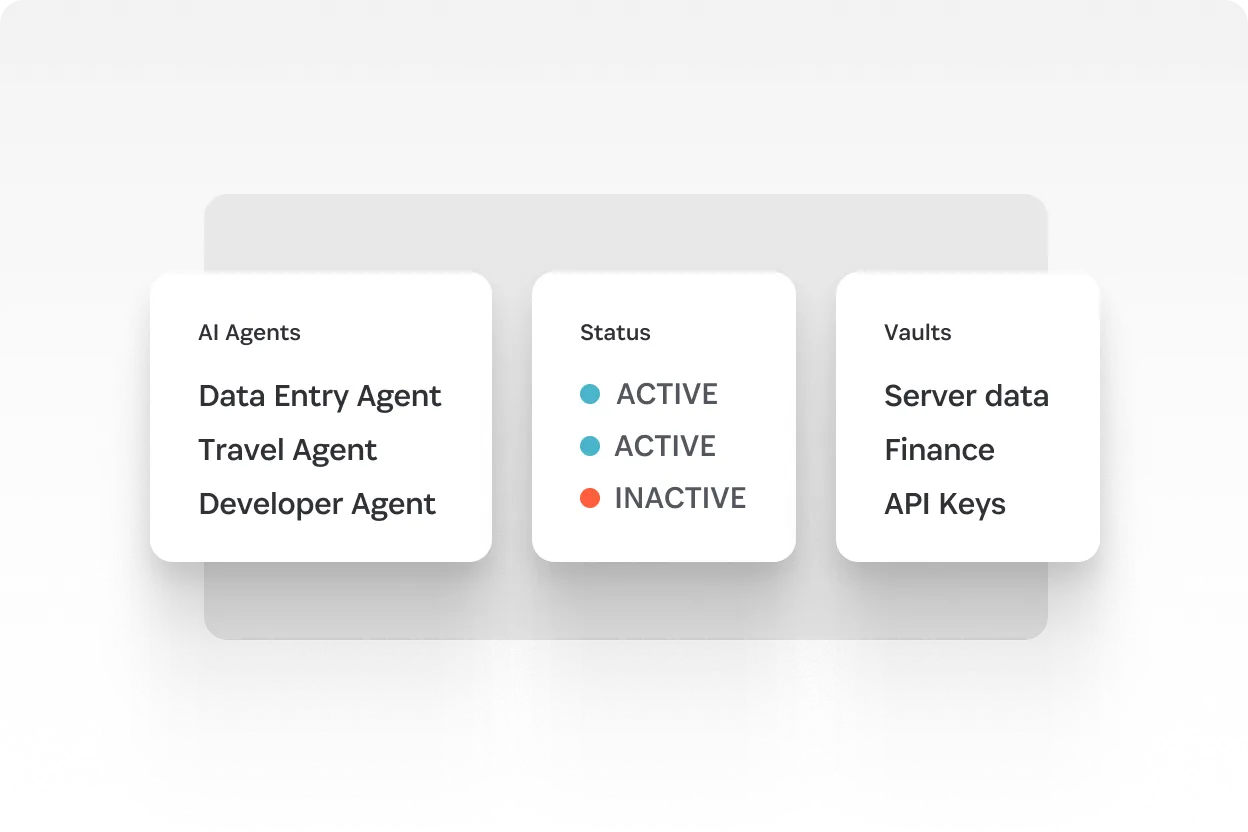

Metti in sicurezza gli agenti che lavorano insieme ai tuoi dipendenti

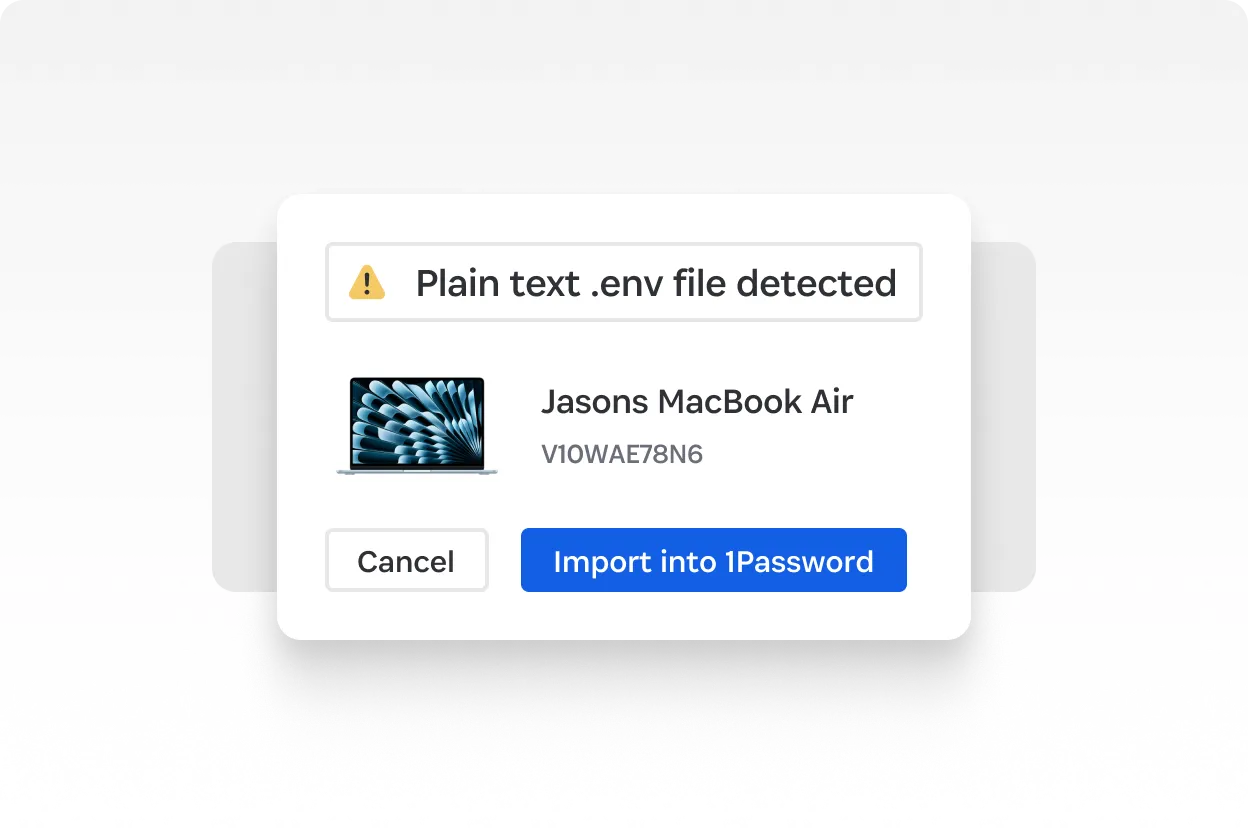

Scopri strumenti di AI e agenti locali che operano su macchine degli sviluppatori e nei browser

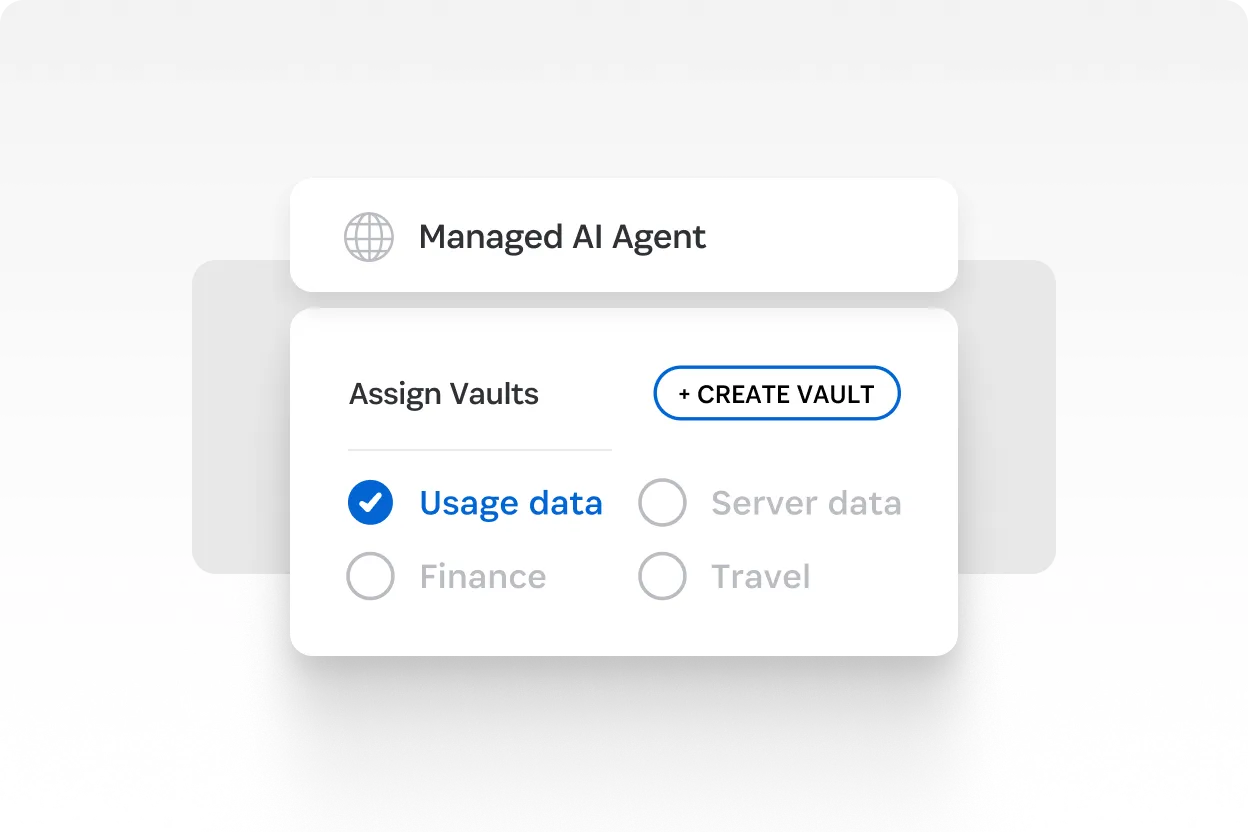

Autentica gli agenti AI in modo sicuro utilizzando credenziali criptate che vengono recuperate da un vault gestito in tempo reale

Sostituisci i file .env e i segreti statici con l'accesso gestito centralmente e basato su criteri.

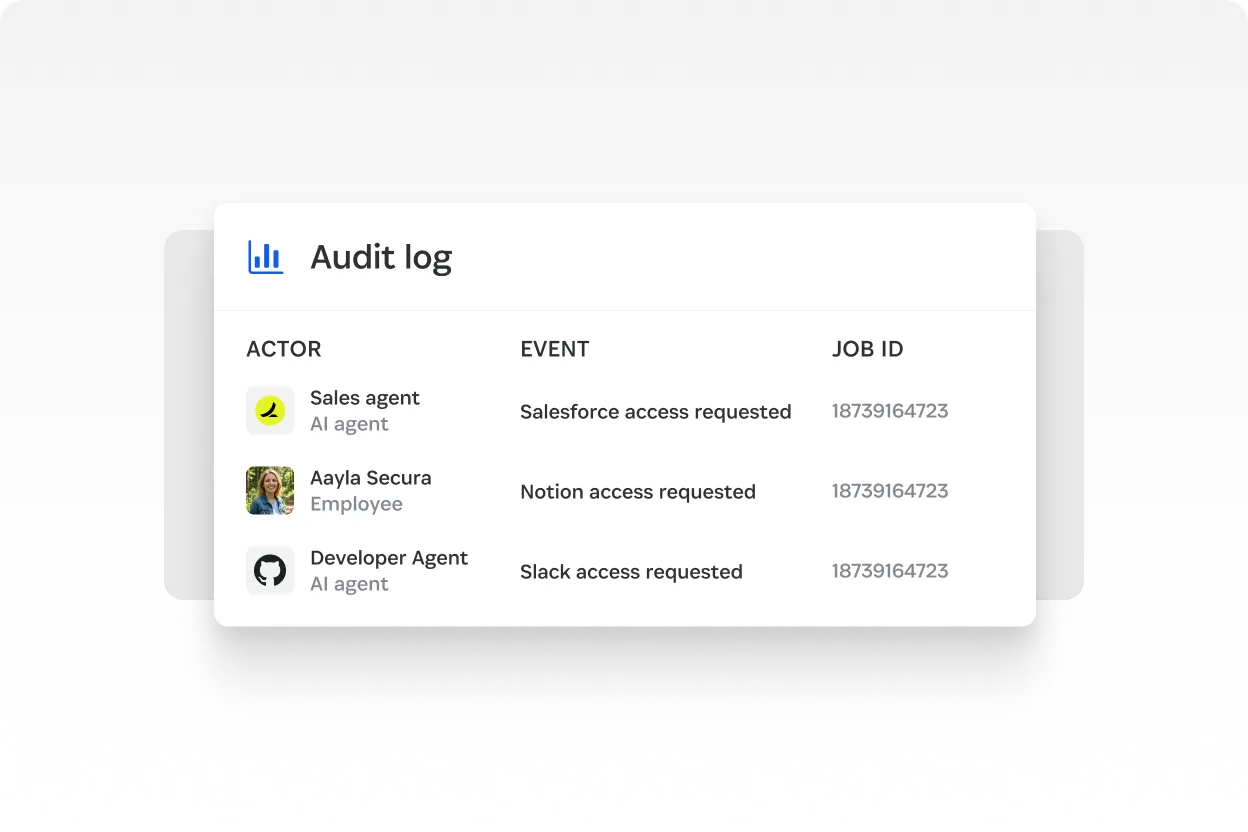

Unifica la verificabilità tra persone, agenti e identità delle macchine

Accesso sicuro per identità umane, agenti e macchine

Scopri l'uso di shadow AI, gli agenti locali e le credenziali esposte tra endpoint e ambienti.

Accesso sicuro con autorizzazione continua e sensibile al contesto prima dell'esercizio dell'autorità

Verifica quando, dove e sotto l'autorità di chi sono state utilizzate credenziali e informazioni riservate tra persone, agenti e identità di macchine

Riduci i rischi garantendo un accesso sicuro da ogni agente AI a ogni applicazione.

Monitora, gestisci e revoca facilmente l'accesso degli agenti AI in un'unica piattaforma.

Ottieni piena visibilità, controllo e governance sull'autenticazione e l'accesso degli agenti AI

Distribuisci agenti AI con sicurezza, governance e supervisione integrate

"Basarsi sulla solida infrastruttura di 1Password SDK e dei relativi strumenti ha consentito a DMNO di creare integrazioni di segreti eccellenti per gli sviluppatori che realizzano flussi di lavoro agentici."

Theo Ephraim

Cofondatore, DMNO

Scelti da 180.000 aziende e milioni di famiglie

Sviluppo AI sicuro

Mentre l'AI trasforma l'IDE moderno, 1Password garantisce che i tuoi segreti, le tue credenziali e i tuoi flussi di lavoro siano protetti senza rallentare l'innovazione.

Sciami di agenti protetti

Scopri come progettare e distribuire sistemi multi-agente autonomi con i controlli di sicurezza necessari per ambienti reali e su scala di produzione.

Principi di sicurezza di 1Password per agenti AI

Gli agenti AI hanno esigenze di sicurezza ben definite. Questi sono i principi che 1Password sta utilizzando per sviluppare e creare soluzioni AI.

Integrazione di 1Password e Browserbase Director

Consente agli agenti AI di Browserbase Director di autenticarsi con i servizi web senza mai esporre le credenziali.

Scopri come 1Password ti aiuta a scoprire e proteggere l'accesso degli agenti AI.

Domande frequenti

Cosa sono gli agenti AI e perché dovrebbero interessarmi?

Gli agenti AI sono strumenti software che possono agire e prendere decisioni autonomamente, come ad esempio rispondere alle domande dei clienti, aggiornare registri o analizzare dati. A differenza dell'AI tradizionale (come i chatbot), gli agenti operano autonomamente su diversi sistemi.

Qual è la differenza tra l'accesso umano e quello di un agente AI?

Perché è importante garantire la sicurezza dell'AI agentica?

Gli agenti AI devono rispettare gli standard di conformità?

Cosa succede se non mettiamo in sicurezza l'AI agentica?

Come faccio a sapere cosa stanno facendo i miei agenti AI?

Cosa succede quando agli agenti AI vengono concesse autorizzazioni in eccesso?

Cosa succede se un agente AI viene compromesso? Come faccio a spegnerlo?

Come può aiutare 1Password?

Quali rischi per la sicurezza derivano dall'hardcoding dei segreti per gli agenti AI?

Come posso utilizzare 1Password con gli agenti che sviluppo internamente?

Come posso impedire che gli agenti AI eludano l'MFA?

Perché gli strumenti IAM tradizionali non bastano per la sicurezza dell'agentic AI?

Cos'è il gap di fiducia degli accessi e in che modo viene amplificato dall'AI agentica?

* GARTNER and MAGIC QUADRANT are registered trademarks and service marks of Gartner, Inc. and/or its affiliates in the U.S. and internationally and is used herein with permission. All rights reserved.